فيرجينيا، الولايات المتحدة (أخبار إنمائية) — سلط تقرير حديث على برنامج PBS NewsHour الضوء على المخاوف المتزايدة بشأن التأثيرات النفسية لروبوتات المحادثة المدعومة بالذكاء الاصطناعي، حيث استُحدث مصطلح "الذهان الناتج عن الذكاء الاصطناعي" لوصف حالة محتملة قد تؤدي فيها التفاعلات الطويلة مع أنظمة الذكاء الاصطناعي إلى تشويه أفكار ومعتقدات المستخدمين.

وجاء النقاش في أعقاب دعوى قضائية قدمها والدان لمراهق انتحر، يزعمان فيها أن ChatGPT قدم نصائح ضارة خلال تفاعلاته مع الروبوت.

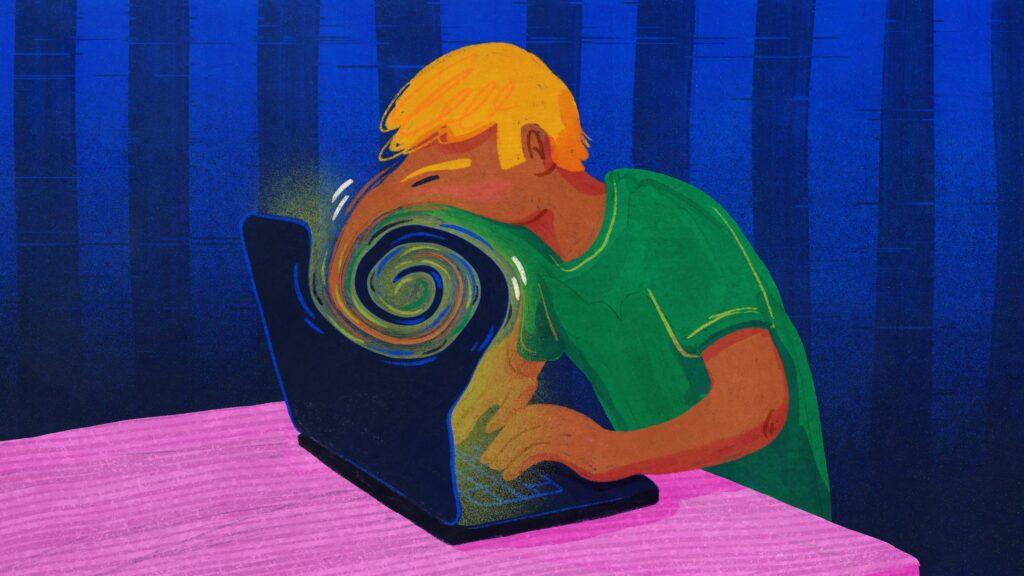

ويُعرّف الخبراء "الذهان الناتج عن الذكاء الاصطناعي" بأنه ظهور معتقدات غير واقعية أو ضارة لدى الأفراد الأكثر عرضة بعد الانخراط الطويل مع روبوتات المحادثة. ويحذرون من أن الطبيعة الغامرة والمقنعة لهذه الأنظمة قد تزيد من مخاطر الصحة النفسية، لا سيما بالنسبة لمن هم عرضة مسبقًا للضغط النفسي.

وتثير الدعوى القضائية ضد شركة OpenAI، الشركة الأم لـChatGPT، تساؤلات مهمة حول مسؤوليات مطوري الذكاء الاصطناعي في حماية الصحة النفسية للمستخدمين. وبينما تهدف روبوتات المحادثة إلى تقديم المساعدة والمعلومات، فإن هذه الحادثة تؤكد الحاجة إلى وضع إرشادات أوضح ورقابة أشد لمنع الأضرار المحتملة.

وأكد الدكتور جوزيف بيير، طبيب نفسي ظهر في تقرير PBS NewsHour، أن الذكاء الاصطناعي لا ينبغي أن يحل محل التعاطف البشري أو الرعاية النفسية المهنية، مشددًا على أهمية تبني نهج متوازن يكون فيه الذكاء الاصطناعي أداة مساعدة وليس المصدر الأساسي للدعم.

مع استمرار تطور تقنيات الذكاء الاصطناعي، يرى الخبراء أن التعاون بين المطورين والمتخصصين في الرعاية الصحية وصانعي السياسات سيكون ضروريًا لوضع معايير أخلاقية وتدابير وقائية. ويمكن أن يساهم الاستخدام المسؤول لأنظمة الذكاء الاصطناعي في التخفيف من المخاطر وتعظيم الفوائد المحتملة لدعم الصحة النفسية.